相談ニーズの増加に対し、有人対応のリソースが追いついていない現状と、そこにある危険性を、公的データを用いて解説します。

文部科学省のデータによれば、子供の自殺数は夏休み明けや深夜帯に急増する傾向にあります。しかし、既存の電話相談窓口の多くは17時〜21時で終了、あるいは24時間対応でも回線数はわずか数本です。

「死にたい」と呟いて電話をかけた時、聞こえてくるのが「プー、プー(話し中)」という無機質な電子音だったとしたら、その絶望感は計り知れません。

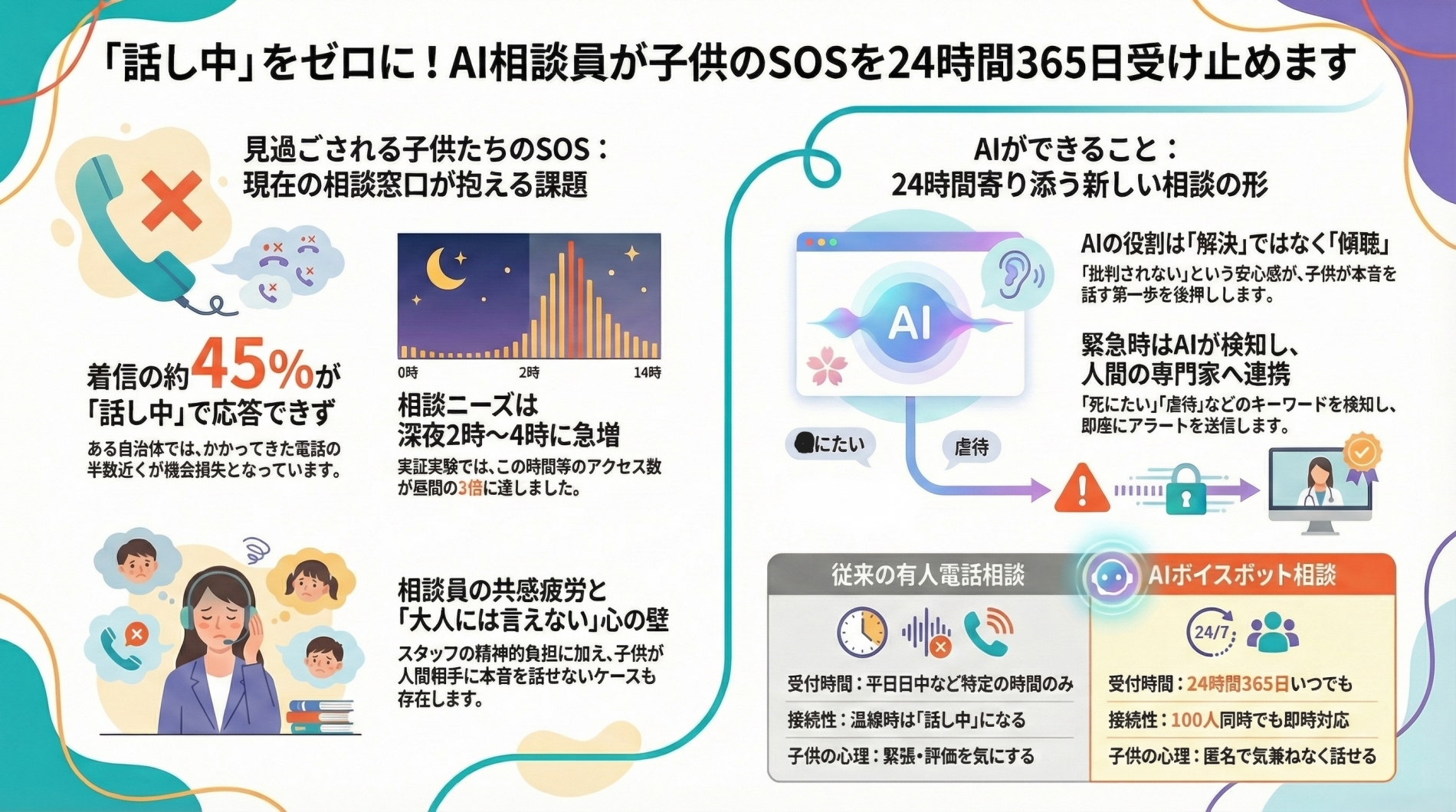

実際、ある自治体の窓口では、着信全体の約45%が「話し中」で切断されているという衝撃的なデータもあります。これは単なる「機会損失」ではありません。行政による「ネグレクト(無視)」と同義になりかねない、構造的な欠陥なのです。

また、常に深刻な悩みに向き合うスタッフの精神的負担(共感疲労)は大きく、離職や休職につながりやすい構造的な課題を抱えています。

加えて、相手が人間だからこそ、「怒られるかも」「知っている大人かも」と警戒して本音を話せない子供がいるという事実も、相談窓口の利用を妨げる大きな壁となっています。

【独自インサイト】当社が実施した実証実験では、AIボイスボットへのアクセスが深夜2時〜4時の時間帯に集中し、昼間の3倍に達しました。これは、子供たちが親の目を避け、孤独を感じる時間にこそ、誰かに話したいという切実なニーズがあることを示しています。

なぜAI相手だと子供たちは本音を話しやすいのか。有人対応との役割分担を整理し、心理的安全性を強調します。

ボイスボットが提供する最大の価値は「心理的安全性」です。「AIなら批判されない」「誰にも知られない」という安心感が、子供の自己開示(本音を話すこと)を促します。

<AI応答例(会話スクリプト)>

AIにできること・できないことを正しく理解し、緊急性の高いケースで人間とどう連携するかの運用設計を解説します。

AIは、複雑な家庭環境への介入や、法的なアドバイスといった**「根本解決」はできません**。ボイスボットはあくまでも「聞くこと」が主な役割です。

しかし、この「聞くこと」が、子供たちが問題の性質上、誰かに相談すること自体が難しいという状況を打破する第一歩となります。

AIはあくまで「最初の受け皿(一次対応)」であること。運用成功の鍵は、AIと人間の相談員との連携フロー設計にかかっています。

具体的には、「死にたい」「虐待」などの緊急性の高いキーワードをAIが検知した場合に、即座に専門スタッフへアラートを出すなどの連携フローを確立することが重要です。

また、相談内容によっては「悩みを解決できなかった子どもたちに対して、こちらから電話をかけたりなどフォローをしてあげることが重要」であり、AIによるログ解析を、人間による後追い支援につなげることが、ボイスボット相談窓口の最終的な目標となります。

A: はい、効果があります。解決策が出なくても、「誰かに話す(言語化する)」こと自体がカタルシス(心の浄化)効果を生み、気持ちを落ち着かせる第一歩になります。AIは、その「最初の声」を確実に受け止めるプロとして機能します。

A: ボイスボットは匿名での利用が前提となっており、誰が話しているか特定されない設計が可能です。運営側が適切な情報管理を行っていることが重要であり、安心して利用できることを子供たちに伝えることがプライバシー保護の観点から求められます。

A: 現在の相談窓口は人手不足でつながりにくい状況が続き、子供のSOSを取りこぼしています。ボイスボットは24時間・匿名・多回線で対応できるため、子どもたちが安心して一歩を踏み出せる「セーフティネットの拡張」として注目されています。

子供たちのSOSに「営業時間外」はありません。AIボイスボットを導入することで、取りこぼしていた「小さな声」を拾い上げ、必要な支援につなぐことができます。

相談員の負担を守りながら、子供たちに「いつでも話を聞くよ」というメッセージを届けませんか?

[自治体・教育機関向け AI相談窓口の事例集を見る]

AIさくらさん(澁谷さくら)

ChatGPTや生成AIなど最新AI技術で、DX推進チームを柔軟にサポート。5分野のAI関連特許、品質保証・クラウドセキュリティISOなどで高品質を約束します。御社の業務内容に合わせて短期間で独自カスタマイズ・個別チューニングしたサービスを納品。登録・チューニングは完全自動対応で、運用時のメンテナンスにも手間が一切かかりません。